Vision-Sensor berechnet Roboterkoordinaten

Kalibrieren statt programmieren

Ein Vision-Sensor erkennt ein Objekt und der Roboter nimmt es auf. Damit dies in der Praxis funktioniert, müssen die Sensorbilder aber zuvor in Roboterkoordinaten umgerechnet werden. Aktuelle Vision-Sensoren verfügen über eine Kalibrierfunktion, mit der sich diese Umrechnung mit wenigen Mausklicks konfigurieren lässt.

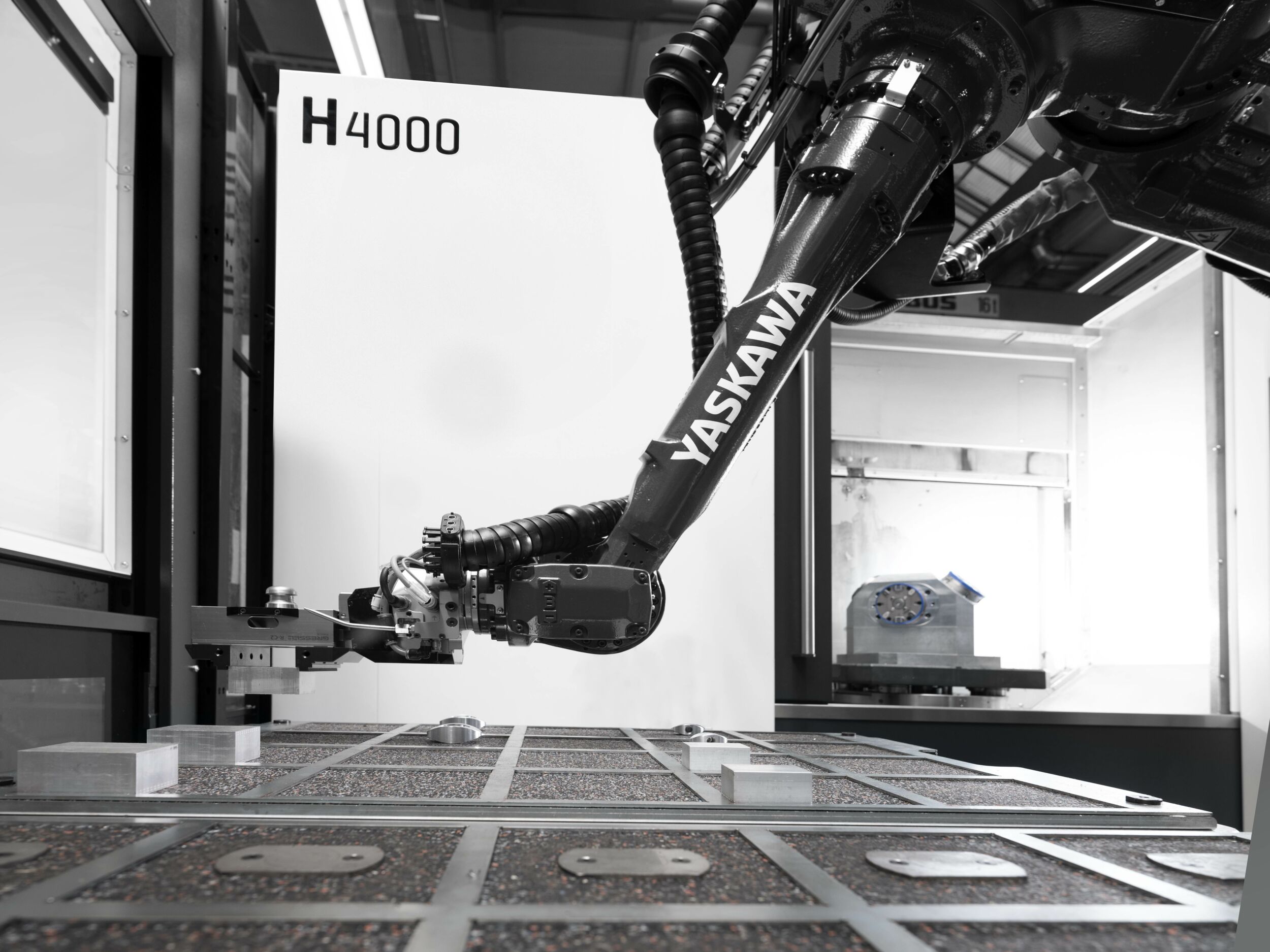

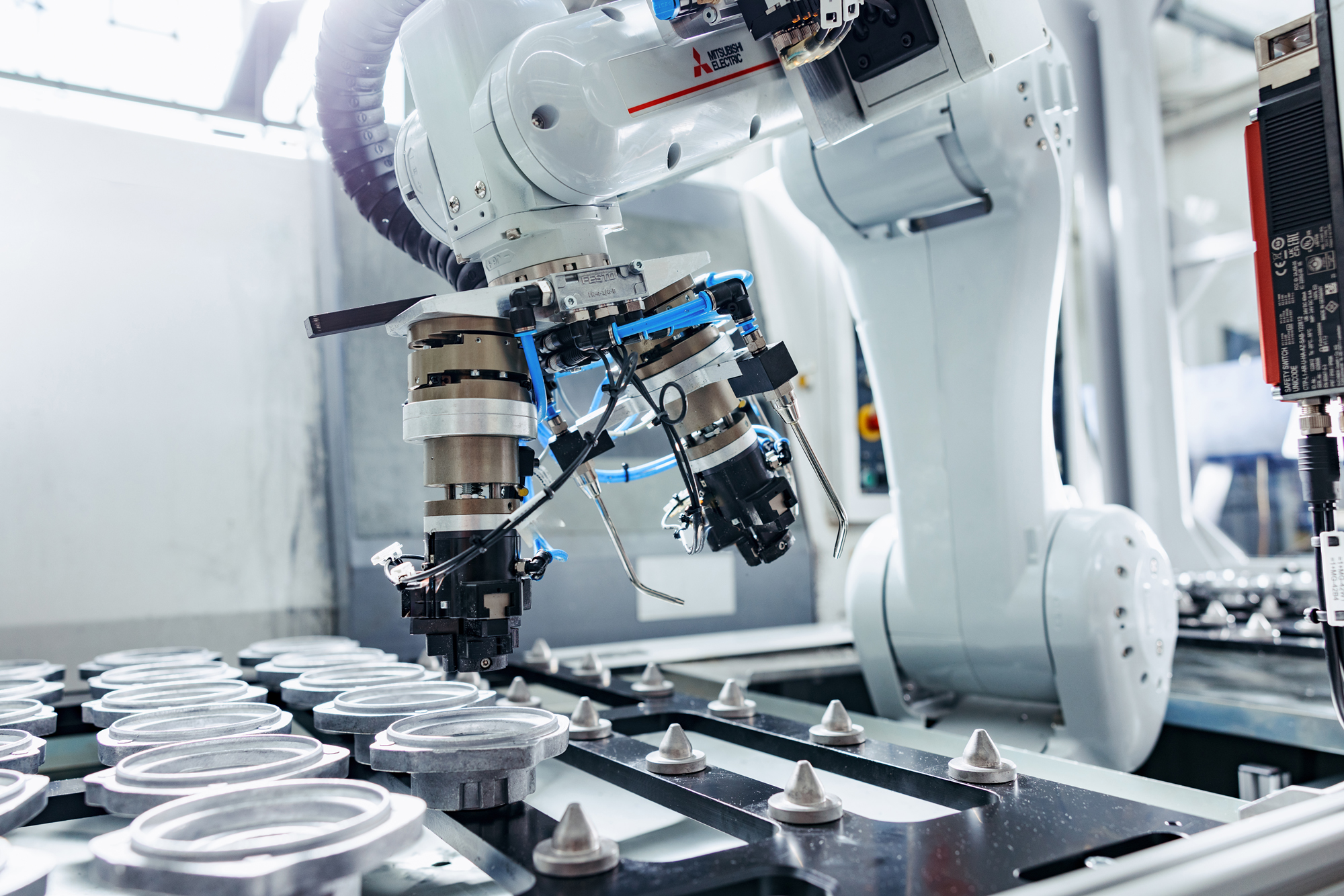

Bevor der Roboter ein Teil greifen kann, müssen die koordinaten des Sensors in Roboterkoordinaten umgerechnet werden. Mit der Visor-Kalibrierfunktion kann u.a. eine Greifpunktverschiebung oder eine Freiraumprüfung vorgenommen werden. (Bild: SensoPart Industriesensorik GmbH)

Handling-Roboter und Vision-Sensoren bewegen sich in zwei verschiedenen Welten: Der Ursprung (0,0) der Sensorkoordinaten liegt meist in der oberen linken Bildecke und Längen-angaben werden in Bildpixeln ausgegeben; der Roboter hingegen benötigt alle Angaben in Millimetern – bezogen auf einen realen Ort in der Welt, z.B. seinen Fußpunkt. Die notwendige Koordinatentransformation bedeutete bisher einen erheblichen Programmieraufwand in der Robotersteuerung, zumal außer der Teileposition auch Faktoren, wie die perspektivische Bildverzerrung aufgrund eines, schrägen Sensor-Blickwinkels sowie die Kissenverzeichnung des Sensorobjektivs zu berücksichtigen waren. Mit den Visor-Vision-Sensoren lässt sich dieser Aufwand nun reduzieren. Die sonst händisch zu erstellenden Routinen sind in Form einer Kalibrierfunktion bereits im Sensor vorkonfiguriert und müssen – ähnlich dem Teach-in bei einem schaltenden Sensor – lediglich an den konkreten Einsatzfall angepasst werden. Hierzu wird eine Punktepaarliste aus Bild- und Weltkoordinaten mit mindestens sechs korrespondierenden Koordinatenpaaren gebildet. Dazu lässt man den Roboter ein Kalibrierteil an verschiedenen Positionen im Sichtfeld des Vision-Sensors ablegen und überträgt die Koordinaten aus der Robotersteuerung in das Sensor-Konfigurationsprogramm, Eingriffe in die Robotersteuerung sind nicht mehr nötig. Einmal kalibriert, übermittelt der Sensor jede Teileposition in absoluten Roboterkoordinaten, sodass der Roboter die Teile ohne weitere Umrechnung direkt greifen kann. Perspektivische Verzerrungen und Objektivverzeichnungen werden durch die Kalibrierung automatisch mitkorrigiert. Der Kalibriervorgang lässt sich mittels Schnittstellenkommandos, z.B. via Ethernet, vollständig automatisieren. Die Kalibrierung lässt sich einfach an wechselnde Teilegeometrien anpassen. So kann ein vertikaler Versatz zwischen Kalibrier- und Messebene oder eine Greifpunktkorrektur berücksichtigt werden. Auch der verfügbare Freiraum rund um das zu greifende Teil lässt sich überprüfen; übereinander oder zu eng liegende Teile werden gar nicht erst an den Roboter gemeldet.