3D-Bewegungsprofile in Echtzeit mittels Bildverarbeitung

Kollisionsvorhersage

Eine neue 3D-Vision-Lösung ermöglicht es, die Bewegungsrichtung und Geschwindigkeit von Objekten im Raum präzise zu ermitteln. Das eröffnet neue Möglichkeiten für die reibungslose Zusammenarbeit von Mensch und Roboter.

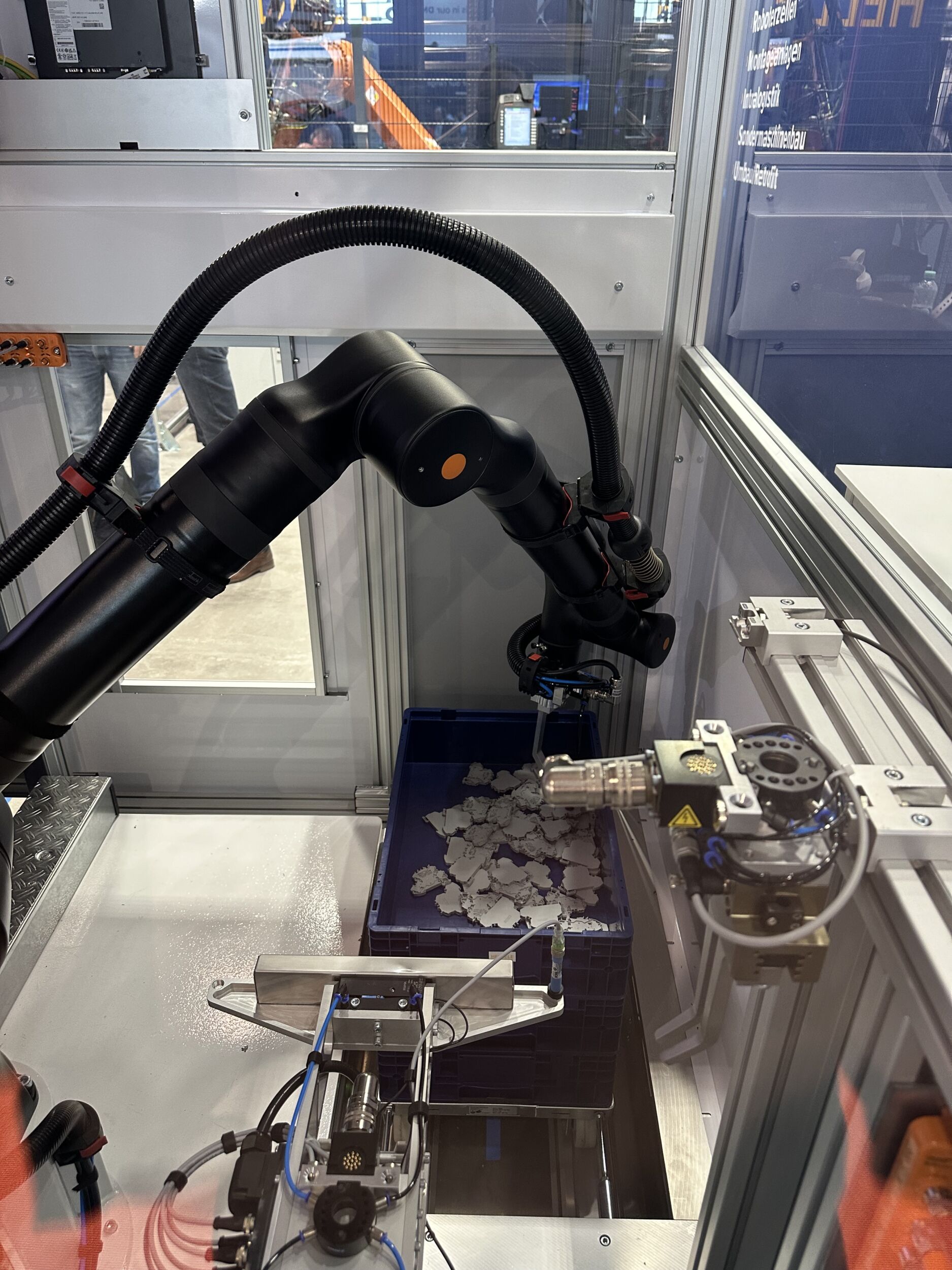

Bahn frei für autonome Gabelstapler dank 3D-basierter Machine-Vision-Technologie. Position, Bewegungsrichtung und Geschwindigkeit von Objekten lassen sich mit dem ´3D-Scene-Flow´-Verfahren im dreidimensionalen Raum ermitteln. (Bild: MVTec Software GmbH)

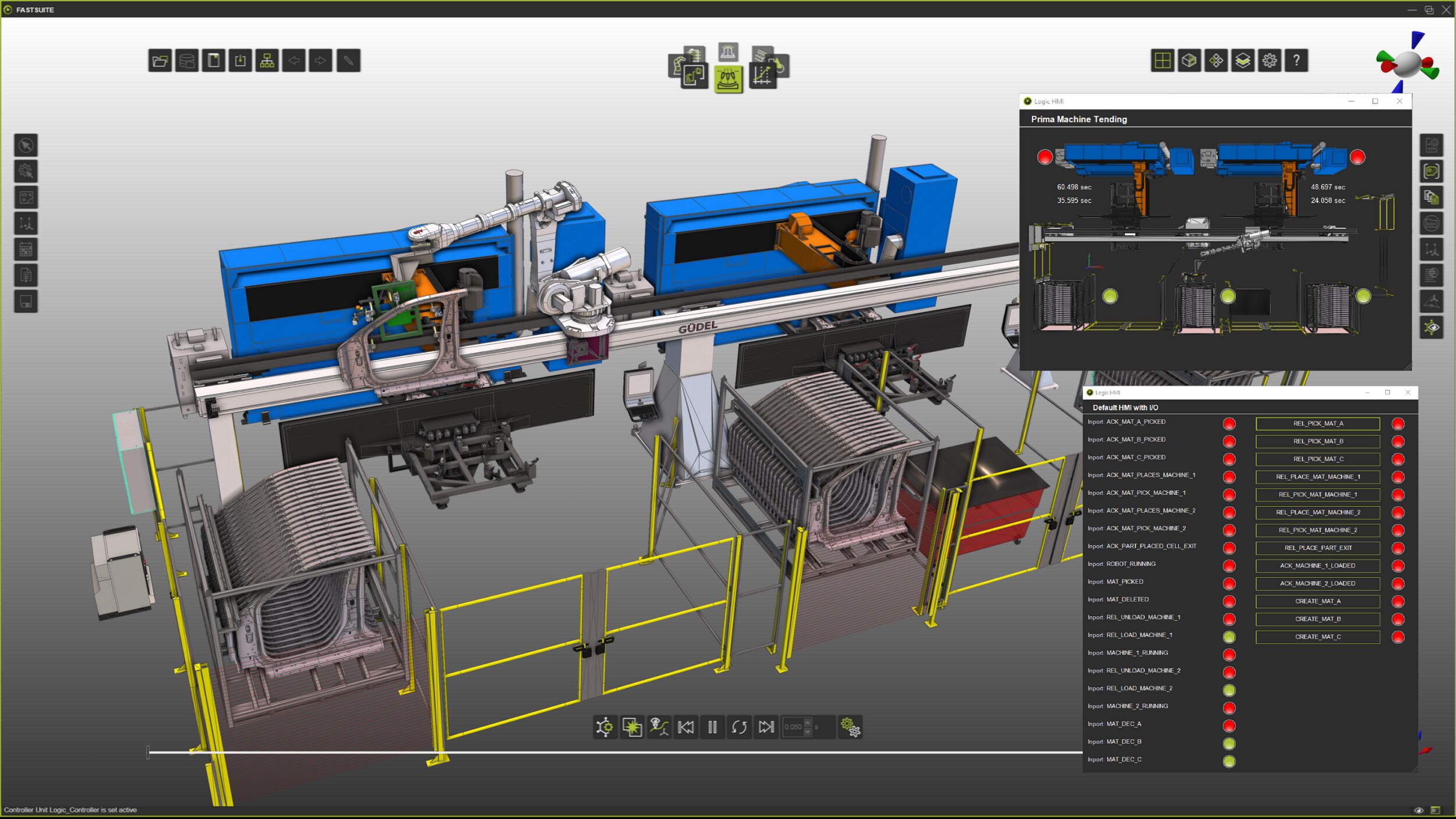

Ein wichtiges Einsatzszenario der industriellen Bildverarbeitung ist die präzise Positionsbestimmung von Objekten in Fertigungsprozessen. Traditionelle, standardisierte Bildverarbeitungssoftware arbeitet jedoch lediglich im 2D-Bereich. So lassen sich Gegenstände, die sich linear bewegen – wie etwa auf einem Fließband – problemlos nachverfolgen. Die Position von dreidimensional agierenden Objekten wie z.B. Montageroboter kann mit 2D hingegen nicht zuverlässig erkannt werden. Daher eignet sich dieses Verfahren nur bedingt für Branchen mit einem hohen Automatisierungsgrad. Eine neue 3D-basierte Vision-Lösung namens 3D Scene Flow schließt nun diese Lücke. Damit kann die Lage von Objekten auch im 3D-Raum zuverlässig bestimmt werden. Hierbei werden an verschiedenen Standorten mehrere Kameras installiert, die digitale Bildinformationen aus unterschiedlichen Perspektiven zur Verfügung stellen (Mehrbild-Kameraaufbau). So lässt sich nicht nur die präzise Position von Gegenständen ermitteln, sondern auch deren Bewegungsrichtung und Geschwindigkeit. 3D Scene Flow wurde nun in die Machine-Vision-Lösung Halcon von MVTec integriert. Die neue Lösung ist in der Lage, die Zusammenarbeit von Menschen und Maschinen in automatisierten Produktionsprozessen deutlich zu verbessern. Das wird an folgendem Beispiel deutlich: Fertigungsroboter, die Schweiß- oder andere Montagevorgänge ausführen, arbeiten meist in einem 3D-Aktionsradius. Dieser ist in der Regel auf bestimmte Fertigungszellen begrenzt. Kommt ein Mitarbeiter dem Bereich zu nahe, schalten Sensoren den Roboter ab, um Kollisionen zu vermeiden. Der Automat muss neu hochgefahren werden, was die Montageprozesse unnötig lange unterbricht und teure Produktionsausfälle zur Folge hat. Mit 3D Scene Flow lässt sich dieses Szenario optimieren: Die an mehreren Stellen installierten Kameras liefern detaillierte Bildinformationen, mit denen sich ein exaktes 3D-Bewegungsprofil von Mensch und Maschine in Echtzeit erstellen lässt. Kreuzen sich die Bahnen beider Akteure, kann dies frühzeitig vorhergesagt werden. Dies bewahrt die Mitarbeiter vor Kollisionen und erhöht die Sicherheit in der Produktion. Zudem muss der Roboter nicht bei jeder Annäherung eines Menschen abgeschaltet werden, sondern nur dann, wenn ein Zusammentreffen laut Bewegungsprofil als sicher erscheint. Das 3D-Verfahren unterstützt auch bei der Interaktion von Menschen mit mobilen Robotern, die sich eigenständig durch die Produktionshallen bewegen. Insbesondere bei großen Online-Versandhändlern dominieren bereits heute autonome Gabelstapler und Hebezeuge die Kommissionierung und Beförderung von Waren im Hochregallager. Aufgrund der neuen Lösung lässt sich dort die Sicherheit im Fahrverkehr deutlich erhöhen.